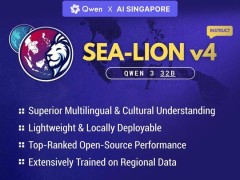

在新加坡國家人工智能計劃(AISG)的最新進展中,一項具有里程碑意義的合作引發了全球關注。該計劃宣布,其最新研發的國家級大語言模型“海獅”(Sea-Lion v4)將徹底摒棄美國技術路線,轉而以阿里的通義千問Qwen3-32B開源模型為核心構建。這一決定標志著中國開源大模型在全球技術競爭中邁出了關鍵一步,尤其是在“主權AI”和“多語言適配”領域展現出強勁實力。

回溯至2023年12月,新加坡啟動了一項耗資7000萬新元(約5200萬美元)的計劃,旨在建立多模態大型語言模型的研究與工程能力,其中核心項目便是開發覆蓋東南亞語言的Sea-Lion。然而,這一擁有6億人口、數字經濟規模接近萬億美元的市場,長期被西方AI技術忽視。以meta Llama 2為代表的主流模型中,東南亞語言內容占比不足0.5%,導致早期基于Llama2訓練的Sea-Lion在區域常識測試中表現堪憂,甚至將南美洲國家委內瑞拉誤列為東盟成員國。

語言與文化的隔閡進一步放大了西方模型的局限性。東南亞地區普遍存在“語碼轉換”現象,即在英語中混入方言,如新加坡式英語(Singlish)或馬來西亞式英語(Manglish)。這種復雜的語言環境對標準美式AI模型構成挑戰,而Llama2等模型在處理泰語、緬甸語等非拉丁語系文字時效率低下,暴露了其“英語中心主義”的基因缺陷。

面對這些痛點,AISG開始重新評估技術路線。他們發現,阿里的Qwen3模型在預訓練階段已通過36萬億個token的數據覆蓋全球119種語言和方言,具備原生多語言能力。這種底層邏輯上的語言理解優勢,顯著降低了后續訓練的門檻。例如,Qwen-Sea-Lion-v4采用字節對編碼(BPE)分詞器,精準切分泰語、緬甸語等無空格文字,不僅提升了翻譯準確度,還大幅優化了推理速度。

商業落地的現實需求也推動了合作深化。東南亞中小企業普遍缺乏高端算力資源,而Qwen-Sea-Lion-v4經過優化后,可在配備32GB內存的消費級筆記本電腦上流暢運行。這一特性使得印尼開發者僅憑一臺高配電腦即可本地部署國家級模型,精準切中了區域算力稀缺的痛點。

此次合作并非單向技術輸出,而是雙向融合的典范。阿里提供通用推理底座,AISG則貢獻其清洗后的1000億個東南亞語言token,這些數據版權風險低且區域內容濃度高達13%,是Llama2的26倍。通過“高級后訓練”技術,阿里將這些區域知識注入模型,使其能精準捕捉當地文化細節。效果立竿見影——在Sea-Helm評估榜單上,搭載阿里技術的Sea-Lion v4迅速登頂同量級開源模型。

從AWS到阿里云,從Llama到Qwen,新加坡Sea-Lion項目的演變折射出全球AI格局的微妙變化。長期以來,美國壟斷著全球技術基礎設施,但中國企業在多語言環境理解和性價比優化上的突破,正使其成為“全球南方”國家構建主權AI的首選伙伴。這一趨勢不僅體現在新加坡,此前硅谷大佬Chamath Palihapitiya選擇Kimi替代OpenAI,美國Vercel、Windsurf等平臺接入智譜模型,以及愛彼迎CEO對阿里Qwen的認可,均印證了中國開源模型的全球競爭力。